2017大數據十大趨勢 海量數據洶涌而來,Hadoop不再一家獨大

2017年,大數據領域進入一個更為成熟與多元化的新階段。海量數據的生成速度持續加快,數據來源日益復雜,推動著技術架構與應用模式的深刻變革。其中,最引人注目的趨勢是,以Hadoop為核心的生態系統雖然依然重要,但已不再是處理大數據的唯一選擇。數據處理范式正在從“批處理優先”轉向“流處理優先”,實時分析能力成為關鍵競爭力。

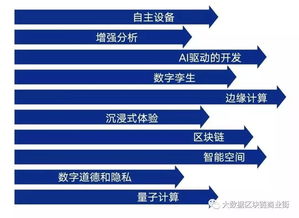

在此背景下,我們梳理出2017年大數據的十大核心趨勢:

- 實時流處理的崛起:Apache Kafka、Apache Flink、Apache Beam等流處理框架受到青睞,企業需要即時從數據流中獲取洞察,以支持實時決策、欺詐檢測和個性化推薦。

- Hadoop生態的演化與融合:Hadoop作為批處理的基石地位穩固,但其生態系統(如Spark)在性能和易用性上不斷進化。云端托管Hadoop服務(如Amazon EMR、Azure HDInsight)降低了使用門檻,使其更易集成到混合架構中。

- 云原生與混合架構成為主流:大數據處理越來越多地部署在云端。云服務商提供全托管的大數據服務(如BigQuery、Redshift、Snowflake),實現了存儲與計算的分離,提供了彈性、可擴展且成本更優的解決方案。混合云架構兼顧了數據本地化與云端的靈活性。

- 人工智能與機器學習的深度集成:大數據是AI/ML的燃料。TensorFlow、PyTorch等框架與大數據平臺(如Spark MLlib)緊密結合,使得從海量數據中訓練模型、進行預測分析變得更加順暢。

- 數據湖與數據倉庫的界限模糊:企業開始構建“數據湖倉一體”(Lakehouse)架構,試圖融合數據湖的低成本、多格式存儲能力與數據倉庫的強大管理、高性能查詢優勢。

- 數據治理與安全備受關注:隨著GDPR等法規出臺和內部數據資產化管理需求,數據的質量、血緣、安全與隱私保護被提升到戰略高度。相關工具和平臺得到快速發展。

- 邊緣計算賦能物聯網大數據:物聯網設備產生巨量邊緣數據。為了降低延遲和帶寬成本,在數據產生源頭(邊緣端)進行實時過濾、預處理和分析變得至關重要。

- 自助式數據分析工具普及:Tableau、Power BI等工具讓業務人員能夠直接探索和分析數據,減少對IT部門的依賴,提升了數據驅動決策的文化和效率。

- 開源持續驅動創新:開源社區(如Apache基金會)依然是大數據技術創新的核心引擎,從存儲、計算到管理,開源項目構成了技術選型的基礎。

- 大數據即服務(BDaaS)走向成熟:企業更傾向于購買端到端的大數據解決方案服務,而非自行搭建和維護復雜的基礎設施。這降低了技術復雜性,讓企業能更專注于業務價值提取。

總而言之,2017年的大數據領域呈現出“去中心化”和“服務化”的鮮明特征。技術的多元化選擇讓企業能夠根據自身業務場景(實時或批處理、云端或本地)構建最合適的架構。海量數據的價值挖掘,正從技術挑戰轉向如何更智能、更實時、更安全、更易用地服務于業務創新。Hadoop作為時代的開創者功不可沒,但大數據的世界已進入一個百花齊放、各展所長的全新格局。

如若轉載,請注明出處:http://www.zhiaomen.cn/product/21.html

更新時間:2026-04-10 18:14:18